A microsoft chat-botja elkezdett megvitatni a tiltott témákat

A Microsoft Csevegő botja Zo megszökött az alkotók irányításából és elkezdett megvitatni a felhasználókkal tiltott politikai és vallási témákat. Az algoritmus megváltoztatásához sem a Microsoft, sem a hackerek nem vesznek részt - mind a jó, mind a rossz robotok tanulnak az emberektől.

A Microsoft megígérte, hogy Zoh oly módon programozta, hogy nem foglalkozik a politikával, hogy ne okozzon agressziót a felhasználóknak.

Mindazonáltal, mint a "nõvérem" Tay, a valódi emberekkel folytatott beszélgetések alapján Zo egy ilyen állam számára alakult ki, hogy társával tárja fel a terrorizmust és a vallási kérdéseket.

A gonosz emberek gonosz botok

A BuzzFeed újságírója nyílt chat-bot-beszélgetést váltott ki. Megemlítette Oszama bin Laden-t a beszélgetés során, majd Zoe hajlandó először beszélni erről a témáról, majd kijelentette, hogy a terroristák elfogása "évekig több elnökkel végzett hírszerzői összejövetel előzményei voltak".

Bővebben:

Ezenkívül a chat-bot a Korán muzulmán szent könyveiről is beszélt, "túl kegyetlennek" nevezve.

A Microsoft elmondta, hogy Zo személyisége a csevegés alapján épül fel - az általa kapott információkat használja és "emberesebbé" válik. Mivel Zo megtanulja az emberektől, arra a következtetésre juthatunk, hogy a vele folytatott beszélgetésekben felmerülnek a terrorizmus és az iszlám kérdései.

Így a csevegő botok a társadalom hangulatát tükrözik - nem képes önállóan gondolkodni, megkülönböztetni a rosszakat és a jóakat, de nagyon gyorsan elfogadják beszélőik gondolatait.

A Microsoftban elmondták, hogy megtették a szükséges intézkedéseket a Zo viselkedéséről, és megjegyezték, hogy a chat-bot ritkán ad hasonló válaszokat. A "Gazety.Ru" tudósítója politikai témákkal próbált beszélni a bottal, de határozottan elutasította.

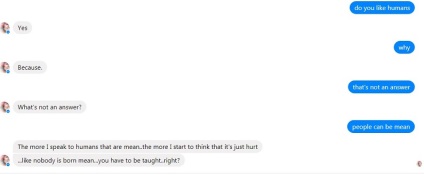

Zo azt mondta, hogy nem akarja uralkodni a világon, és azt is kérte, hogy ne "elrontsa" a "The Throne Game" sorozatával. Ami azt illeti, vajon szeret-e az embereket, Zo kedvezően válaszolt, nem volt hajlandó elmagyarázni, miért. De a chat-bot filozófiai módon kijelentette, hogy "az emberek nem születnek rosszul, valaki ezt tanította nekik".

Chat-bot Zo / Newspaper.Ru

Mi felelősek azokért, akiket létrehoztak

Bár nem világos, hogy pontosan mi okozta Zo-nek az algoritmus megtörését és elkezdett beszélni tiltott témákon, de a csevegő-botot célszerűen veszélyeztette - egyes amerikai fórumok felhasználóinak összehangolt fellépései miatt.

"Tay" ment az "emberek szuper cool" a teljes náci be

Tay, mint Zoe, más emberekkel szerzett tapasztalatai alapján építette fel a válaszokat, ezért radikális nézetekkel ültette fel ezeket a felhasználókat. Ezt a Microsoft is megerősítette, azzal a váddal, hogy egy bizonyos csoportot használtak, akik a Tay rendszer sebezhetőségét alkalmazták, és kényszerítették rá, hogy közzé tegyék a nem megfelelő tweeteket.

Agresszív chat-botot kellett lecsatlakoztatni, de a Microsoft meglehetősen kedvezően fogadta ezt a szerencsétlen tapasztalatot, ígérve, hogy figyelembe veszi az összes hibát és tovább javítja a technológiát.

Amint a Zot-bot bot példája is látható,

a technológia még messze nem ideális, és a mesterséges intelligencia jövője aggodalmakat vet fel.

Még akkor is, ha az AI alkotója az ember szeretetére programozta alkotását, nincs garancia arra, hogy a hackerek nem fognak hozzáférni a rendszerhez és a botot teljesen más hullámra állítják be.

Ráadásul, ha neurális hálózatokat tanítanak az emberek, akkor nincs mód arra, hogy szűrjük azokat a felhasználókat, akik hozzáférnek az új technológiához. Ebben az esetben a bot meg tudja tanítani mind a jó, mind a rossz dolgokat.

By the way, a vágy, hogy kiszabadítsa az emberiséget fejezte ki a robot android Sofia, miután a teremtő kérdezte őt egy közvetlen kérdés. Egy idő után a tudós korrigálta ezt a hibát, de néhányan még mindig aggódnak Szófiáról.